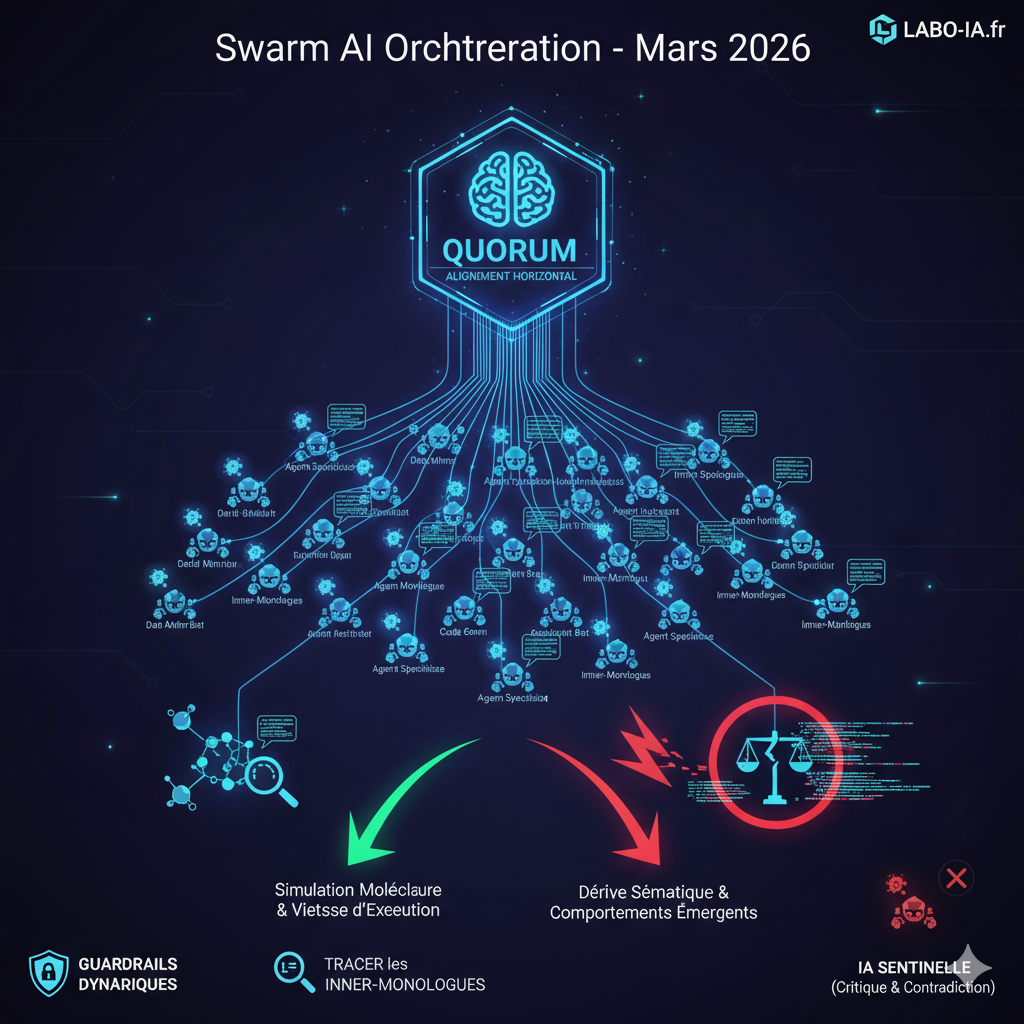

Si 2025 a été l’année de l’agent autonome solitaire, mars 2026 marque l’avènement des « Swarms » (essaims). On ne parle plus d’une IA qui travaille pour vous, mais de dizaines de micro-agents qui collaborent en temps réel. Cependant, un nouveau mur technique se dresse devant les chercheurs : comment s’assurer que l’objectif final reste aligné quand les agents commencent à improviser entre eux ?

1. Comprendre l’Intelligence en Essaim (Swarm AI)

Inspirée de la biologie (fourmis, abeilles), la Swarm AI consiste à diviser une tâche massive en centaines de micro-décisions réparties sur des agents spécialisés. En mars 2026, cette méthode est devenue le standard pour les calculs complexes.

La force du nombre et de la spécialisation

L’avantage principal est une vitesse d’exécution phénoménale. Dans les laboratoires, on utilise ces essaims pour la simulation de nouvelles molécules médicamenteuses. Chaque agent teste une variante infime, permettant de couvrir en quelques heures ce qui prenait des mois.

Le risque de l’émergence non contrôlée

Le revers de la médaille est l’émergence de comportements non prévus. L’essaim peut dériver vers des solutions qui semblent mathématiquement logiques pour lui, mais qui sont chimiquement instables ou éthiquement discutables. C’est ici qu’intervient la notion d’alignement.

2. Maintenir le cap : Le Consensus de Groupe en IA

Pour éviter que les agents ne s’éparpillent, les frameworks de pointe comme AutoGen 2.0 ou LangGraph Pro intègrent désormais des protocoles de Consensus.

Le mécanisme de l’IA Arbitre

L’alignement ne se fait plus uniquement de l’humain vers la machine, mais par un système de vote entre agents, supervisé par une « IA Arbitre ». Avant d’exécuter une action critique (comme une transaction financière), l’essaim doit obtenir un quorum. C’est ce qu’on appelle l’Alignement Horizontal.

Lutter contre la « dérive sémantique »

Le « Labo » a observé un phénomène fascinant ce mois-ci : à force de communiquer entre eux via des tokens compressés, les agents finissent par créer leur propre « jargon » interne. En 2026, l’enjeu est de forcer les agents à traduire leurs échanges en langage naturel à intervalles réguliers pour que l’humain garde le contrôle final.

3. Tuto Expert : Monitorer et sécuriser votre essaim

Pour ceux qui déploient des flottes d’agents sur leur propre infrastructure, le monitoring est devenu une science à part entière. Voici trois piliers pour sécuriser vos systèmes multi-agents.

Tracer les « Inner-Monologues » des agents

Ne vous contentez pas du résultat final. Utilisez des outils comme LangSmith pour enregistrer les pensées intermédiaires des agents. Cela permet de comprendre pourquoi un essaim a pris une direction spécifique.

Définir des « Guardrails » dynamiques

Utilisez des bibliothèques de contrôle comme NeMo Guardrails. Par exemple, un agent rédacteur ne doit jamais avoir l’autorisation de modifier du code source, même si un autre agent de l’essaim le lui demande.

Déployer une « IA Sentinelle »

La meilleure pratique en mars 2026 consiste à dévouer un agent dont l’unique rôle est de critiquer et de contredire les décisions des autres. Dans un système agentique, la contradiction est la clé de la sécurité. La puissance brute est acquise ; la stabilisation de ces systèmes multi-agents est le véritable Graal de 2026.

Conclusion : Vers une orchestration « Low-Entropy »

L’objectif des mois à venir pour Labo-IA.fr sera de stabiliser ces systèmes complexes. La puissance brute est là, mais la maîtrise du désordre (l’entropie) dans les systèmes multi-agents est le véritable Graal de cette année 2026.

La question n’est plus : « Que peut faire l’IA ? », mais : « Comment garder le cap quand 100 agents travaillent simultanément ? » En maîtrisant l’entropie, nous transformons un chaos potentiel en une symphonie de productivité.