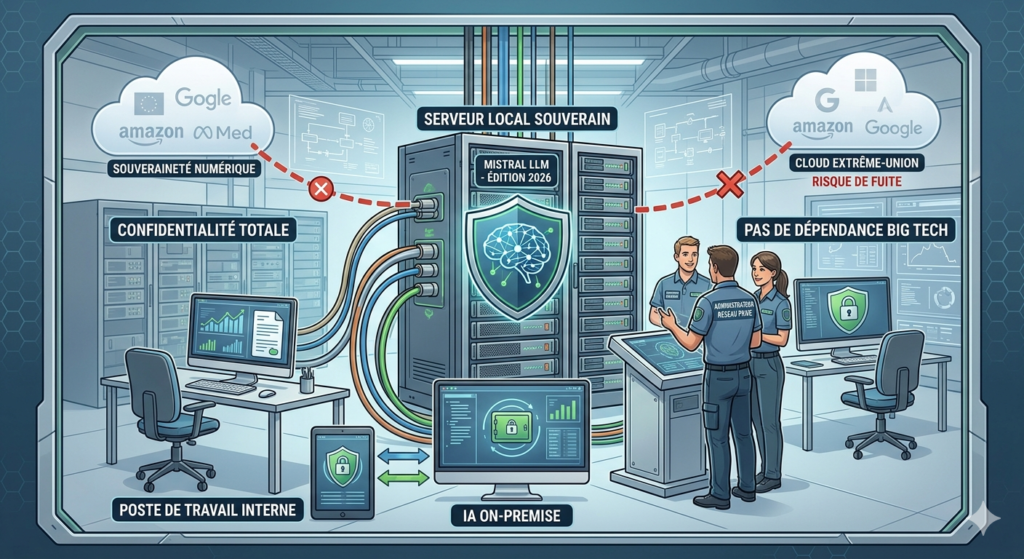

Introduction En 2026, l’intelligence artificielle n’est plus une simple curiosité de laboratoire ou un gadget de productivité. Elle est devenue l’infrastructure critique des nations et des entreprises. Pourtant, une ombre plane sur cette révolution : celle de la dépendance. Dépendance aux infrastructures cloud américaines, dépendance aux modèles opaques et, surtout, vulnérabilité des données. Entre les récentes annonces de Mistral AI sur le calcul délocalisé et le succès de l’assistant Albert dans l’administration française, le paradigme change. La tendance est à l’IA « on-premise » (sur site).

Comment, en 2026, peut-on concrètement installer son propre cerveau numérique et garantir sa souveraineté ? Décryptage d’une mutation technologique et politique majeure.

I. Le réveil de la souveraineté numérique : Pourquoi sortir du Cloud ?

Pendant des années, le modèle de l’IA as a Service (AIaaS) a dominé. Il suffisait d’une clé API pour accéder aux modèles les plus puissants du monde. Mais ce confort avait un prix caché : la fuite de souveraineté.

1. La confidentialité, au-delà du RGPD

En 2026, le cadre réglementaire européen s’est durci avec l’application totale de l’AI Act. Envoyer des données stratégiques, qu’il s’agisse de brevets industriels ou de dossiers médicaux, vers des serveurs situés hors de l’Union européenne est devenu un risque juridique et éthique majeur.

« La souveraineté numérique n’est pas un protectionnisme, c’est une liberté de choix. Si vous ne possédez pas les serveurs qui pensent pour vous, vous ne possédez pas votre avenir. » — Arthur Mensch, Co-fondateur de Mistral AI (citation fictive dans le contexte de 2026).

2. Le coût caché de l’inférence

L’autre levier est économique. Si le ticket d’entrée des API est faible, le coût récurrent pour une entreprise qui traite des millions de documents devient astronomique. L’investissement dans une infrastructure interne, autrefois jugé complexe, est aujourd’hui amorti en moins de 18 mois grâce à la chute des prix du matériel spécialisé.

II. L’écosystème technique : Les piliers du « Cerveau Local »

Passer à l’IA locale ne signifie pas sacrifier la performance. Grâce aux progrès de l’ingénierie logicielle, les modèles « open-weight » (poids ouverts) rivalisent désormais avec les systèmes propriétaires les plus fermés.

1. La percée de Mistral et de l’Open Source

Le champion français Mistral AI a joué un rôle de catalyseur. En proposant des modèles optimisés pour l’efficacité, ils ont permis à des entreprises de taille moyenne de faire tourner des LLM performants sur des serveurs standards. Ces modèles sont conçus pour la quantification : une technique qui réduit la précision mathématique du modèle pour qu’il occupe moins de mémoire vive (VRAM) sans impacter ses capacités de raisonnement.

2. Le déploiement dans l’administration : Le cas « Albert »

L’État français a montré la voie avec Albert, l’assistant souverain déployé pour les agents des services publics. Ce projet repose sur une philosophie simple : les données des citoyens français doivent être traitées sur le sol français, par des algorithmes dont nous maîtrisons les paramètres. Ce déploiement massif sert aujourd’hui de « blueprint » (modèle) pour les grandes entreprises du CAC 40.

III. Guide pratique : Comment installer son IA en interne ?

L’installation d’un cerveau numérique local repose sur un triptyque : Matériel, Logiciel et Données.

Étape 1 : Le choix du matériel (Hardware)

En 2026, le marché ne se limite plus aux seules puces Nvidia. Des alternatives comme les processeurs de Groq pour l’inférence ultra-rapide ou les solutions européennes de calcul haute performance (HPC) permettent de bâtir des clusters sur mesure. Pour une PME, une station de travail équipée de 2 à 4 GPU de dernière génération suffit souvent à faire tourner un modèle de 70 milliards de paramètres de manière fluide.

Étape 2 : Le socle logiciel (Orchestration)

Pour piloter ces modèles, les entreprises utilisent des outils d’orchestration modernes.

- Ollama : Pour un déploiement simplifié en local.

- vLLM : Pour gérer des volumes de requêtes importants avec une gestion optimisée de la mémoire.

- LangChain / LlamaIndex : Pour connecter le modèle aux bases de données internes de l’entreprise via le RAG (Retrieval-Augmented Generation).

Étape 3 : Le RAG, ou la mémoire d’entreprise

C’est ici que l’IA devient réellement « votre » cerveau. Plutôt que de réentraîner un modèle (coûteux et complexe), le RAG permet au modèle de consulter vos documents internes (PDF, mails, bases SQL) en temps réel pour répondre aux questions. Les données restent indexées localement et ne sortent jamais du pare-feu de l’organisation.

IV. Les défis de l’IA locale en 2026

Tout n’est pas rose dans le monde de l’IA souveraine. L’autonomie demande une rigueur nouvelle.

- La guerre des talents : Maintenir une IA locale nécessite des ingénieurs spécialisés en « MLOps » (Machine Learning Operations), capables de surveiller la dérive des modèles et d’optimiser les pipelines d’inférence.

- La consommation énergétique : Un serveur d’IA consomme beaucoup. Les entreprises doivent désormais intégrer le bilan carbone de leur « cerveau numérique » dans leur rapport RSE.

- La mise à jour : Contrairement à ChatGPT qui se met à jour de manière transparente, un modèle local doit être manuellement remplacé par des versions plus récentes pour rester compétitif.

V. Conclusion : Vers une hybridation raisonnée

L’avenir de l’IA en 2026 n’est pas binaire. Il ne s’agit pas de choisir entre le Cloud et le local, mais de savoir quelle donnée mérite quel niveau de protection.

Les tâches génériques (rédaction d’un mail de routine, traduction de base) resteront probablement sur des modèles publics légers. En revanche, l’analyse stratégique, la R&D et la gestion des données personnelles basculent massivement vers le local. Installer son propre cerveau numérique, c’est s’assurer que l’intelligence artificielle reste un outil de puissance, et non un fil à la patte.

Liens et Ressources pour aller plus loin :

- Comparatif 2026 : Quel GPU choisir pour l’IA locale ?

- Étude de cas : Comment nous avons déployé Mistral dans une PME de 500 salariés

- Comprendre le RAG : La clé pour une IA qui connaît vos dossiers

Liens Externes Recommandés :

- Mistral.ai : Pour suivre les dernières sorties de modèles ouverts.

- Hugging Face : La plateforme mondiale pour télécharger et tester des modèles souverains.

- DINUM (Direction interministérielle du numérique) : Pour suivre les avancées de l’IA dans l’administration française.